Jede Vermögensverwaltung hat einen Kern. Eine Grundidee, mit der sie dem scheinbar wirren Auf und Ab an der Börse möglichst viel Gewinn abzutrotzen versucht. Scalable Capital setzt auf dynamisches Risikomanagement. Das Ziel lautet: Anleger sollen möglichst auch dann gut schlafen können, wenn die Börse bebt. Die Portfolios sollen in Abschwungphasen stabiler sein als der Markt und so langfristig überdurchschnittliche risikoadjustierte Renditen abwerfen.

Der Ansatz, der hinter einem dynamischen Risikomanagement steckt, klingt erst mal simpel: Steigt das Risiko im Portfolio, werden risikoreiche Anlagen wie Aktien abgebaut. Umgekehrt werden diese Anlagen aufgestockt, falls das Portfoliorisiko sinkt. Das ist jedoch leichter gesagt als getan. Das Ganze funktioniert nur, wenn das Risikomanagement rechtzeitig warnt, sobald die Märkte in unsicheres Fahrwasser steuern. Denn es hilft wenig, wenn erst dann umgeschichtet wird, wenn die Kurse schon weit abgestürzt sind.

Ein dynamisches Risikomanagement kann solche Warnsignale liefern. Nicht für alle Abschwünge. So kommen etwa Crashs, die durch externe Schocks wie Terroranschläge oder Naturkatastrophen ausgelöst werden, ohne Vorwarnung. Aber manche Kursstürze kündigen sich an – durch Vorbeben, denen die Investoren zunächst oft nicht viel Bedeutung beimessen. Aufgetreten sind sie zum Beispiel rund um das Brexit-Votum oder vor der heftigen Börsentalfahrt im Jahr 2008.

Die Subprime-Krise – eine ideale Krise

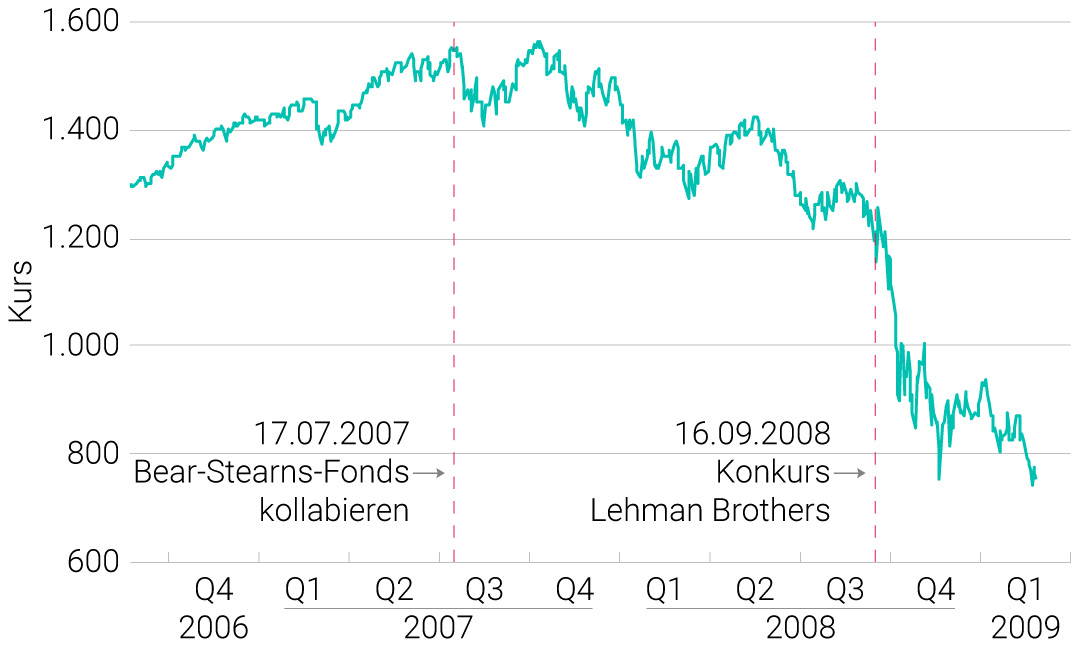

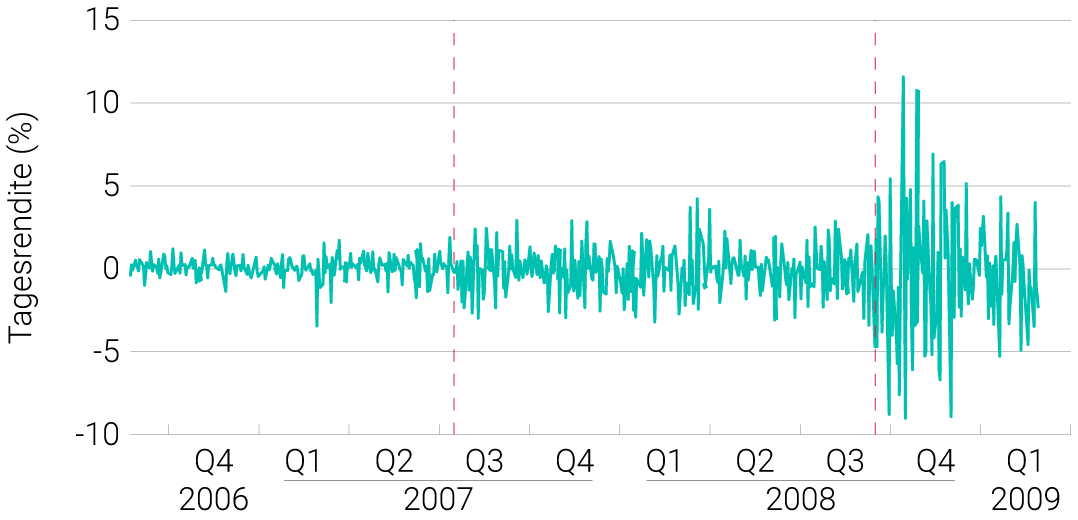

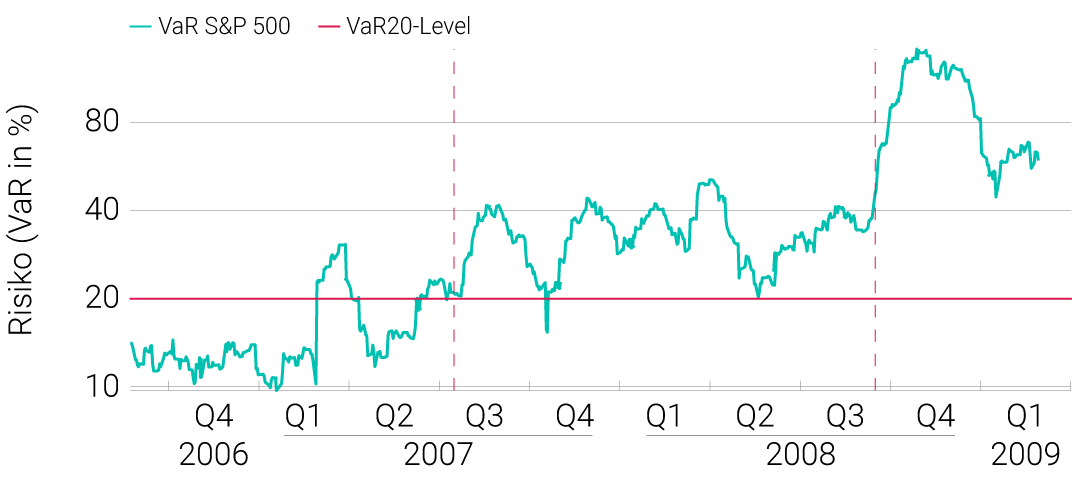

Sehen wir uns das Beispiel der großen Finanzkrise vor rund zehn Jahren einmal genauer an. Wie ein dynamisches Risikomanagement frühe Erschütterungen an der Börse identifizieren kann, erkläre ich gern anhand von drei Grafiken (s. unten). Sie zeigen:

- den US-Aktienindex S&P 500

- die täglichen Renditen dieses Index

- das Risiko des Index, gemessen am Value-at-Risk (VaR)

Was ist damals passiert? Zwei Ereignisse stechen heraus. Am 17. Juli 2007 meldete die US-Investmentbank Bear Stearns, dass zwei ihrer Hedgefonds praktisch wertlos waren. Grund: Sie hatten sich mit Derivaten auf Hypothekenkredite verspekuliert. Ein Warnschuss für die Finanzwelt. Jetzt ahnte sie, dass am US-Immobilienmarkt etwas nicht rund läuft. Dennoch kamen die Börsenkurse in New York nur kurzzeitig unter Druck. Der S&P 500 pendelte noch einige Monate auf und ab. Erst 2008 ging er in den Sinkflug über, wie die erste Grafik zeigt.

Dynamisches Risikomanagement in der Finanzkrise

Nach dem Kollaps der Bear-Stearns-Fonds im Sommer 2007 pendelte der S&P 500 noch monatelang auf und ab, bevor er einbrach. Aber…

…die Tagesrenditen des Index schwankten schon ab dem Zusammenbruch der Fonds auffällig stark, und…

…das Risikomaß Value-at-Risk (VaR) stieg ab diesem Zeitpunkt dauerhaft über die Marke von 20 Prozent.

Hinweis: Weder vergangene Wertentwicklungen noch Prognosen haben eine verlässliche Aussagekraft über zukünftige Wertentwicklungen.

Das zweite Ereignis war die Pleite von Lehman Brothers, vermeldet am 15. September 2008. Jetzt war offensichtlich, dass die Immobilienkrise auch mächtige Finanzhäuser ausradieren kann. Doch so erschreckend diese Erkenntnis auch war: Wieder fiel der S&P 500 nicht abrupt. Zwei Wochen vergingen, bevor er massiv abzustürzen begann. Zum Jahresende hatte der Crash weltweit rund 16 Billionen Dollar vernichtet.

Jetzt kommt der entscheidende Punkt: Die Kursgewitter nach Bear Stearns und Lehman haben sich angedeutet. Das zeigt die zweite Grafik. Sie gibt die täglichen Schwankungen des S&P 500 wieder. Damit gewährt sie sozusagen einen Blick „unter die Oberfläche”. Man sieht: Als die beiden Bear-Stearns-Fonds kollabierten, trat der Markt in eine neue Phase ein. Die täglichen Renditen an der Wall Street schlugen doppelt so stark aus wie zuvor, und zwar viele Monate lang. Ein ähnlicher „Bruch” ist beim Lehman-Kollaps zu erkennen. Hier begannen die Kurse bereits vor dem Insolvenzantrag stärker auszuschlagen, die Schwankungen verharrten am Ende sogar für einige Wochen auf dem dreifachen Niveau.

Was bedeutet das für den Investor? Die Kursschwankungen wirkten wie ein Alarmsignal. Wer sein Portfolio nach der Bears-Stearns-Meldung sukzessive in risikoärmere Anlagen umgeschichtet hätte, den hätte der Abschwung im Jahr 2008 nicht voll erwischt. Und wer sich ab dem Lehman-Schock von risikoreichen Anlagen verabschiedet hätte, der wäre immer noch mit einem blauen Auge davongekommen, weil die Mehrheit der Börsianer erst zwei Wochen später die dramatischen Folgen der Pleite erfasste und die Kurse in den Sturzflug schickte.

Das bedeutet: Die große Baisse der Finanzkrise kam nicht aus heiterem Himmel, auch wenn es vielen Anlegern so vorkam. Ein dynamisches Risikomanagement kann bei Crashs wie dem von 2008 als Frühwarnsystem wirken, indem es das Risiko an den Börsen ständig überwacht.

Das ist nicht immer so einfach, wie es im Nachhinein erscheinen mag. Es gibt weit ausgefeiltere Methoden, um Risikoentwicklungen einzuschätzen, als nur die aktuellen Kursschwankungen zu messen. Und unfehlbar sind diese Methoden auch nicht. Ein Kurseinbruch wie nach dem verheerenden Unglück im japanischen Kernkraftwerk Fukushima im März 2011 ließe sich damit zum Beispiel nicht frühzeitig erkennen. Dennoch: Wenn sich eine Börsenkrise durch steigende Fluktuationen andeutet, kann ein dynamisches Risikomanagement diese Fluktuationen identifizieren. Es kann abschätzen, welche Gefahren davon für das Depot ausgehen, und daraus sinnvolle Handlungsanweisungen ableiten.

Wie, das verdeutlicht Grafik Nummer drei. Sie zeigt den Value-at-Risk (VaR) des S&P 500. Diese Risikokennzahl gibt an, welchen prozentualen Verlust der Index auf Sicht von einem Jahr mit einer Wahrscheinlichkeit von 95 Prozent nicht überschreitet. Nach dem Zusammenbruch der Hedgefonds von Bear Stearns im Jahr 2007 lag diese Verlustschwelle fast durchweg bei mehr als 20 Prozent, während sie zuvor beinahe immer unter dieser Marke notierte.

Hochrisikophasen umschiffen

Angenommen das tolerierte Verlustrisiko eines Anlegers liegt bei einem VaR von 20 Prozent. Dann hätte ein dynamisches Risikomanagement die US-Aktienquote in seinem Portfolio nach dem Risikoanstieg im Juli 2007 sukzessive reduziert. Und mit dem Anstieg der Kursschwankungen um den Lehman-Kollaps hätte es den Anteil von risikoreichen Anlagen noch weiter heruntergefahren. Insgesamt wäre so viel Schaden vom Anleger abgewendet worden. Denn in den Monaten vor dem Bear-Stearns-Ereignis wären US-Aktien sicher übergewichtet gewesen – wegen des seinerzeit sehr geringen Risikos.

Und was ist mit der Regel, dass mehr Risiko auch mehr Rendite bringt? Das dynamische Risikomanagement scheint gegen diesen Grundsatz zu verstoßen, weil es darauf ausgerichtet ist, Hochrisikophasen zu umschiffen. Der Widerspruch lässt sich mithilfe der modernen Börsenforschung auflösen. Denn nicht immer wird ein höheres Risiko mit höheren Renditen belohnt. Das Gesetz gilt nur im langfristigen Durchschnitt. Wenn das Risiko kurzfristig nach oben schießt, sind dagegen erst mal geringere Renditen – oder sogar Verluste – zu erwarten. Das haben unter anderem die beiden US-Wissenschaftler Alan Moreira und Tyler Muir von der US-Universität Yale im Jahr 2016 belegt (siehe auch unsere Seite zur Performance-Optimierung). Sie haben untersucht, wie sich eine risikobasierte Strategie in den vergangenen 90 Jahren in den USA geschlagen hätte. Elf Prozent pro Jahr hätte ihr Ansatz abgeworfen – zwei Prozentpunkte mehr als die US-Börse. Muir fasst das Ergebnis so zusammen: „In volatilen Marktphasen existieren deutlich höhere Risiken. Wenn man nicht adäquat für die Übernahme dieser Risiken entlohnt wird, dann ist die richtige Strategie, den Markt zu verlassen.”

Dafür steht dynamisches Risikomanagement: Risiken meiden, die sich nicht auszahlen. Das wird nicht immer gelingen. Aber wenn man damit ein paar heftige Abschwünge dämpft, ist langfristig viel gewonnen.

Bild: Arnold Exconde / Unsplash.com

Risikohinweis – Die Kapitalanlage ist mit Risiken verbunden und kann zum Verlust des eingesetzten Vermögens führen. Weder vergangene Wertentwicklungen noch Prognosen haben eine verlässliche Aussagekraft über zukünftige Wertentwicklungen. Wir erbringen keine Anlage-, Rechts- und/oder Steuerberatung. Sollte diese Website Informationen über den Kapitalmarkt, Finanzinstrumente und/oder sonstige für die Kapitalanlage relevante Themen enthalten, so dienen diese Informationen ausschließlich der allgemeinen Erläuterung der von Unternehmen unserer Unternehmensgruppe erbrachten Wertpapierdienstleistungen. Bitte lesen Sie auch unsere Risikohinweise und Nutzungsbedingungen.